- ����������

cd hadoop��װ·��/ect/hadoop

��hdfs-site.xml������������?

<property>?

<name>dfs.permissions</name>?

<value>false</value>?

</property>

ּ��ȡ��Ȩ��飬ԭ����Ϊ�˽������windows����������eclipse����hadoop������ʱ������map/reduce���Ӻ����´���org.apache.hadoop.security.AccessControlException: Permission denied:

?

��hdfs-site.xml������������ ��Ŀǰ���Կ�ѡ ���ݾ��������

<property>?

<name>dfs.web.ugi</name>?

<value>228238,supergroup</value>?

</property>?

ԭ��������ʱ�������´��� WARN org.apache.hadoop.security.ShellBasedUnixGroupsMapping: got exception trying to get groups for user 228238 (228238 �����û���)

�������������hadoop��Ⱥ��?

[root@supervisor-84 sbin]# ./stop-dfs.sh

[root@supervisor-84 sbin]# ./sbin/stop-yarn.sh?

[root@supervisor-84 sbin]#./sbin/start-dfs.sh?

[root@supervisor-84 sbin]# ./sbin/start-yarn.sh

?

- windows����������

windows7(x64),jdk,ant,eclipse,hadoop

jdk��������?

jdk-6u26-windows-i586.exe��װ��ú��������JAVA_HOME��������,����binĿ¼���õ�path

?

eclipse��������?

eclipse-standard-luna-SR1-win32.zip��ѹ��F:\eclipse\

? ? ? ??���ص�ַ��http://developer.eclipsesource.com/technology/epp/luna/eclipse-standard-luna-SR1-win32.zip

?

ant��������?

apache-ant-1.9.4-bin.zip��ѹ��D:\apache-ant\�����û�������ANT_HOME,����binĿ¼���õ�path?

���ص�ַ��http://mirror.bit.edu.cn/apache//ant/binaries/apache-ant-1.9.4-bin.zip

?

����hadoop-2.5.2.tar.gz?

http://mirror.bit.edu.cn/apache/hadoop/common/hadoop-2.5.2/hadoop-2.5.2.tar.gz

����hadoop-2.5.2-src.tar.gz?

http://mirror.bit.edu.cn/apache/hadoop/common/hadoop-2.5.2/hadoop-2.5.2-src.tar.gz?

?

����hadoop2x-eclipse-plugin?

https://github.com/winghc/hadoop2x-eclipse-plugin?

?

����hadoop-common-2.2.0-bin?

https://github.com/srccodes/hadoop-common-2.2.0-bin?

?

�ֱ�hadoop-2.5.2.tar.gz��hadoop-2.5.2-src.tar.gz��hadoop2x-eclipse-plugin��hadoop-common-2.2.0-bin���ؽ�ѹ��F:\hadoop\Ŀ¼��?

?

ע: ��ѹ�� hadoop-2.5.2 \share\hadoop\common\lib ��ȱ�� htrace-core-3.0.4.jar, ���Դ��������طŵ���Ŀ¼��

?

- ����hadoop-eclipse-plugin-2.5.2.jar����

���ӻ�������HADOOP_HOME=F:\hadoop\hadoop-2.5.2\?

�ӻ�������path���ݣ�%HADOOP_HOME%/bin?

�ı�������������汾��Ϣ?

��F:\hadoop\hadoop2x-eclipse-plugin-master\ivy\libraries.properties?

hadoop.version=2.5.2?

jackson.version=1.9.13

ant����?

F:\hadoop\hadoop2x-eclipse-plugin-master\src\contrib\eclipse-plugin>?

ant jar -Dversion=2.5.2 -Declipse.home=F:\eclipse\eclipse-hadoop\eclipse -Dhadoop.home=F:\hadoop\hadoop-2.5.2

����ú�hadoop-eclipse-plugin-2.5.2.jar����F:\hadoop\hadoop2x-eclipse-plugin-master\build\contrib\eclipse-pluginĿ¼��

?

- eclipse��������

������õ�hadoop-eclipse-plugin-2.5.2.jar������eclipse��pluginsĿ¼�£�Ȼ������eclipse?

?

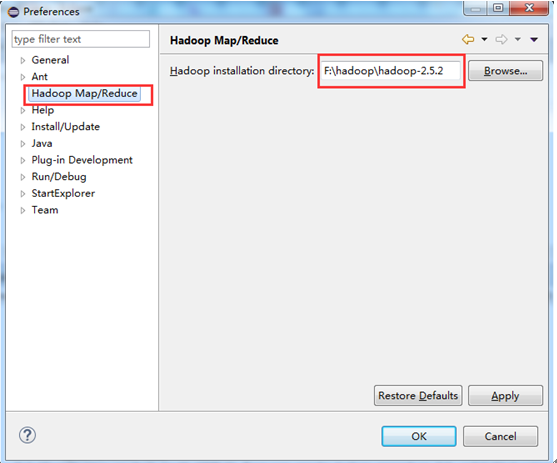

2.�˵�Window--Preference--Hadoop Map/Reduce�������ã�����ͼ��ʾ��

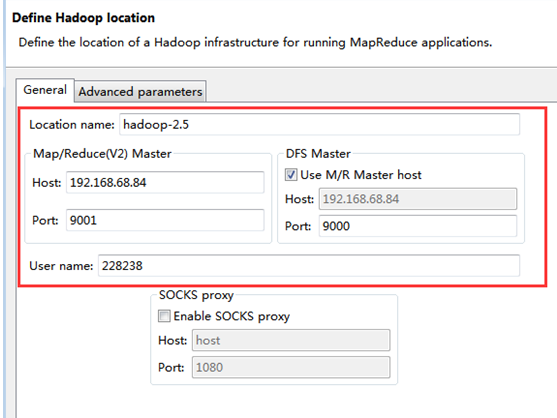

?��ʾHadoop�������ô��ڣ�Window--Show View--Other-MapReduce Tools,����ͼ��ʾ��

?

��������Hadoop������ͼ��ʾ��

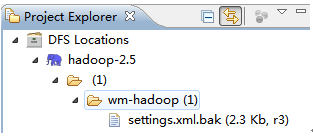

?�鿴�Ƿ����ӳɹ����½��ļ��в��ϴ��ļ��ܿ�������������Ϣ�����ʾ���ӳɹ���

?

- Map/Reduce Project ���̴���

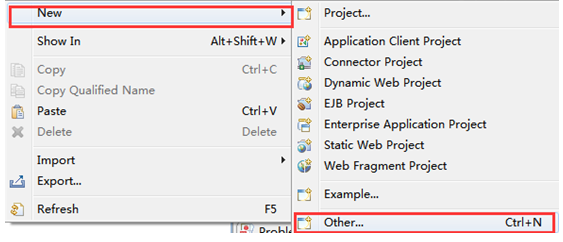

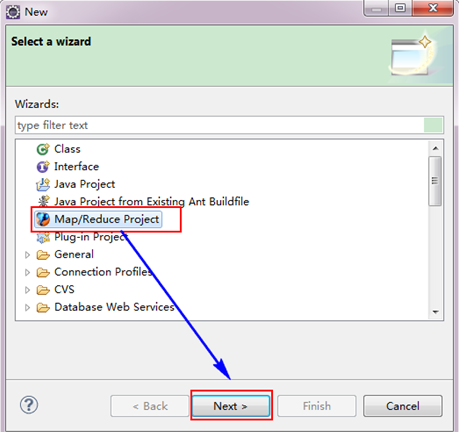

�ڹ��������һ���꣬ѡ��new �C-�� other �C�� Map/Reduce Project

?

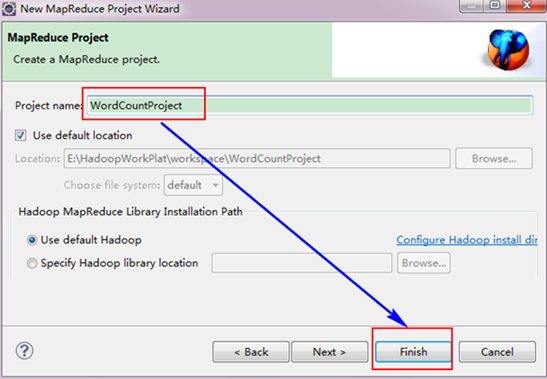

?���ţ���дMapReduce���̵�����Ϊ"WordCountProject"�����"finish"��ɡ�

?

?

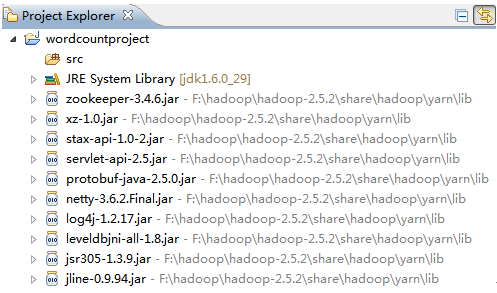

??ĿǰΪֹ�����Ѿ��ɹ�������MapReduce��Ŀ�����Ƿ�����Eclipse���������������ǵĸղŽ�������Ŀ��

?

����log4j.properties�ļ� ?Ŀ������eclipse ����̨����־���

��srcĿ¼�´���log4j.properties�ļ����������£�?

log4j.rootLogger=debug,stdout,R?

log4j.appender.stdout=org.apache.log4j.ConsoleAppender?

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout?

log4j.appender.stdout.layout.ConversionPattern=%5p - %m%n?

log4j.appender.R=org.apache.log4j.RollingFileAppender?

log4j.appender.R.File=mapreduce_test.log?

log4j.appender.R.MaxFileSize=1MB?

log4j.appender.R.MaxBackupIndex=1?

log4j.appender.R.layout=org.apache.log4j.PatternLayout?

log4j.appender.R.layout.ConversionPattern=%p %t %c - %m%n?

log4j.logger.com.codefutures=DEBUG

?ע�� �� winutils.exe �� hadoop.dll ������˵��hadoop-common-2.2.0-bin �п����ҵ����� ���뵽 F:\hadoop\hadoop-2.5.2\bin Ŀ¼��

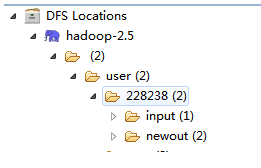

�� DFS Locations �� user Ŀ¼���½� 228238 (PC ���û���) �ļ��У��ڸ��ļ����½� input �ļ��У����� ��Ľ��Ϊ newout Ŀ¼�¡�

?�½� �� WordCount��������org.apache.hadoop.examples

?

public class WordCount {

?

? public static class TokenizerMapper

? ? ? ?extends Mapper<Object, Text, Text, IntWritable>{

? ? ?

? ? private final static IntWritable one = new IntWritable(1);

? ? private Text word = new Text();

public void map(Object key, Text value, Context context

? ? ? ? ? ? ? ? ? ? ) throws IOException, InterruptedException {

? ? ? StringTokenizer itr = new StringTokenizer(value.toString());

? ? ? while (itr.hasMoreTokens()) {

? ? ? ? word.set(itr.nextToken());

? ? ? ? context.write(word, one); ? ? ?}

? ? }

? }

public static class IntSumReducer extends

Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

?

public void reduce(Text key, Iterable<IntWritable> values, Context context)

throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

?public static void main(String[] args) throws Exception {

// ?��ʼ��Configuration

? ? Configuration conf = new Configuration();

? ? conf.set("mapred.job.tracker", "192.168.68.84:9001");

? ? String[] ars=new String[]{"input","newout"};

// ? GenericOptionsParser�࣬�����������ͳ���hadoop���

// ? ?��������ҪΪConfiguration����������Ӧ��ֵ����ʵƽʱ���������Dz�̫��������

// ? ?��������ʵ��Tool�ӿڣ�Ȼ����main������ʹ��ToolRunner���г���

// ? ?��ToolRunner�ڲ������GenericOptionsParser

? ? String[] otherArgs = new GenericOptionsParser(conf, ars).getRemainingArgs();

// ? ?����WordCount����ʱ��һ��������������������Ǿͻᱨ���˳�

? ? if (otherArgs.length != 2) {

? ? ? System.err.println("Usage: wordcount ?");

? ? ? System.exit(2);

? ? }

// ? ?�ڹ���һ��job

? ? Job job = new Job(conf, "word count");

// ? ?װ�ر�д�õļ������

? ? job.setJarByClass(WordCount.class);

// ? ?װ��map����

? ? job.setMapperClass(TokenizerMapper.class);

? ? job.setCombinerClass(IntSumReducer.class);

// ? ?װ��reduce����ʵ����

? ? job.setReducerClass(IntSumReducer.class);

// ? ?���������key/value������

? ? job.setOutputKeyClass(Text.class);

? ? job.setOutputValueClass(IntWritable.class);

// ? ?��������������ļ�

? ? FileInputFormat.addInputPath(job, new Path(otherArgs[0]));

// ? ?��������������ļ�

? ? FileOutputFormat.setOutputPath(job, new Path(otherArgs[1]));

// ? ?���job���гɹ��ˣ����ǵij���ͻ������˳�

? ? System.exit(job.waitForCompletion(true) ? 0 : 1);

? }

}

?

?

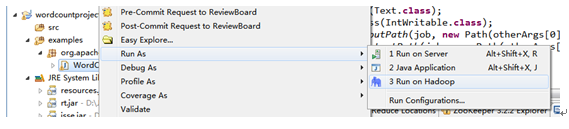

�һ� Run AS ? Run on hadoop

?

?

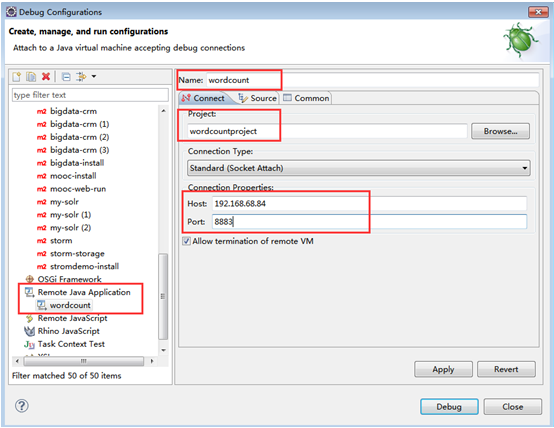

Debug ?���� ����

��mapred-site.xml�ļ��������������ã�

<property> ?

? <name>mapred.child.java.opts</name> ?

? <value>-agentlib:jdwp=transport=dt_socket,address=8883,server=y,suspend=y</value> ?

</property>

�Ҽ�hadoop src��Ŀ���Ҽ���Debug As����ѡ��Debug Configurations����ѡ��Remote Java Application��������һ���µIJ��ԣ�����Զ��host ip�ͼ����˿ڣ���Ϊ8883��Ȼ������Debug����ť

?

?